Keinotekoinen älykkyys on kulkenut pitkä matka R2-D2: n jälkeen. Nykyään suurin osa vuosituhansista menetetään ilman älykkäitä GPS-järjestelmiä. Robotit navigoivat jo taistelukentillä, ja droonit saattavat pian toimittaa Amazon-paketteja ovellemme.

Siri osaa ratkaista monimutkaiset yhtälöt ja kertoa sinulle, kuinka keittää riisiä. Hän on jopa todistanut pystyvänsä vastaamaan kysymyksiin jopa huumorilla.

Mutta kaikki nämä ennakot riippuvat siitä, että käyttäjä antaa AI-suunnan. Mitä tapahtuisi, jos GPS-yksiköt päättäisivät, etteivät halua mennä kuivapesuun, tai mikä pahempaa, Siri päättäisi, että hänestä voi tulla älykkäämpi ilman sinua?

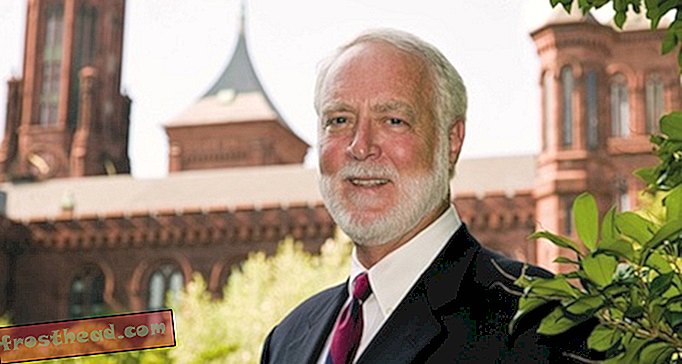

Viimeinen keksintömme: tekoäly ja ihmiskauden loppu. "> Lopullinen keksintömme: tekoäly ja ihmiskauden loppu. ">" Ennen kuin jaamme planeetan superälykkäiden koneiden kanssa, meidän on kehitettävä tiede niiden ymmärtämiseksi. Muutoin he ottavat hallinnan ", kirjoittaja James Barrat sanoo uudesta kirjastaan " Viimeinen keksintömme: tekoäly ja ihmiskauden loppu . "(James Barratin kohteliaisuus)

Lopullinen keksintömme: tekoäly ja ihmiskauden loppu. ">" Ennen kuin jaamme planeetan superälykkäiden koneiden kanssa, meidän on kehitettävä tiede niiden ymmärtämiseksi. Muutoin he ottavat hallinnan ", kirjoittaja James Barrat sanoo uudesta kirjastaan " Viimeinen keksintömme: tekoäly ja ihmiskauden loppu . "(James Barratin kohteliaisuus) Nämä ovat vain tahmeimmat tulokset. Kirjailija ja dokumenttielokuvantekijä James Barrat ennustaa uudessa kirjassaan "Viimeinen keksintömme: tekoäly ja ihmisen aikakauden loppu" .

Aikaisemmin, Barratin mukaan, tekoäly - Siristä drooneihin ja tiedon louhintajärjestelmiin - lakkaa etsimästä ihmisille päivityksiä ja alkaa etsiä parannuksia yksin. Ja toisin kuin tieteiskirjallisuuden R2-D2 ja HAL, tulevaisuutemme AI ei välttämättä ole ystävällisiä, hän sanoo: ne voivat todella olla ne, jotka tuhoavat meidät.

Lyhyesti sanoen, voitko selittää suuren ideasi?

Tällä vuosisadalla tutkijat luovat koneita, joiden älykkyys on yhtä suuri ja ylittää sitten oman. Mutta ennen kuin jaamme planeetan erittäin älykkäiden koneiden kanssa, meidän on kehitettävä tiede niiden ymmärtämiseksi. Muuten he ottavat hallinnan. Ja ei, tämä ei ole tieteiskirjallisuutta.

Tutkijat ovat jo luoneet koneita, jotka ovat parempia kuin ihmiset shakissa, Jeopardy!, navigointi, tiedon louhinta, haku, lauseen todistaminen ja lukemattomat muut tehtävät. Lopulta luodaan koneita, jotka ovat parempia kuin ihmiset AI-tutkimuksessa

Siinä vaiheessa he pystyvät parantamaan omia ominaisuuksiaan nopeasti. Nämä itseparantuvat koneet pyrkivät luomaan tavoitteisiinsa, olivatpa ne sitten avaruuden etsintä, shakin pelaaminen tai varaston poimiminen. Menestyäkseen he etsivät ja käyttävät resursseja, oli se sitten energiaa tai rahaa. He pyrkivät välttämään vikatiloja, kuten sammuttamista tai pistorasian katkaisemista. Lyhyesti sanottuna, he kehittävät asemia, mukaan lukien itsesuojaus ja resurssien hankinta - ajavat aivan kuten omamme. He eivät epäröi kerjää, lainaa, varasta ja pahempaa saadakseen tarvitsemansa.

Kuinka olet kiinnostunut tästä aiheesta?

Olen dokumenttielokuvien ohjaaja. Haastattelin vuonna 2000 keksijän Ray Kurzweilin, robotisti Rodney Brooksin ja sci-fi-legendan Arthur C. Clarken TLC-elokuvalle, joka koski romaanin ja elokuvan tekemistä 2001: A Space Odyssey. Haastatteluissa tutkittiin Hal 9000 -konseptin ja pahanlaatuisten tietokoneiden ideaa. Kurzweilin kirjoissa on kuvattu AI: n tulevaisuus räikeällä "singulaarisuudella", ajanjaksona, jolloin teknologinen kehitys ylittää ihmisen kyvyn ymmärtää niitä. Silti hän odotti vain hyviä asioita, jotka syntyvät AI: stä ja jotka ovat riittävän vahvoja vastaamaan ja ylittämään ihmisen älykkyyden. Hän ennustaa, että pystymme ohjelmoimaan kehomme solut uudelleen torjumaan sairaudet ja ikääntymisen. Kehitämme erittäin kestävää nanobotit, jotka toimittavat enemmän happea kuin punasolut. Lataamme aivomme tietokoneimplantteilla, jotta meistä tulee älykkäitä. Ja siirrämme aivomme kestävämmälle välineelle kuin nykyinen "märkäohjelma" ja elämme ikuisesti, jos haluamme. Brooks oli optimistinen ja vaati, että AI: llä parannetut robotit olisivat liittolaisia, eivät uhkia.

Tutkijaksi kääntynyt kirjailija Clarke puolestaan oli pessimistinen. Hän kertoi minulle, että älykkyys voittaa, ja ihmiset kilpailevat todennäköisesti selviytymisestä superälykkäiden koneiden kanssa. Hän ei ollut tarkka siitä, mitä tapahtuisi, kun jaamme planeetan superälykkäiden koneiden kanssa, mutta hän koki, että se olisi ihmiskunnan taistelu, jota emme voittaisi.

Se oli vastoin kaikkea mitä olin ajatellut AI: stä, joten aloin haastatella tekoälyn asiantuntijoita.

Mitä todisteita sinulla on ideasi tukemiseksi?

Kehittynyt tekoäly on kaksikäyttöinen tekniikka, kuten ydinfissio, joka voi aiheuttaa suuria vahinkoja tai suuria haittoja. Olemme vasta alkamassa havaita haittoja.

NSA: n yksityisyysskandaali syntyi, koska NSA kehitti erittäin hienostuneita tiedonkeruun työkaluja. Virasto käytti voimaansa pilata miljoonien puhelujen metatiedot ja koko Internet - kriittisesti kaikki sähköpostit. Tietojen louhinnan AI: n viettämä virasto, jonka tehtävänä oli suojella perustuslakia, käytti sen sijaan väärin sitä. He ovat kehittäneet työkaluja, jotka ovat liian tehokkaita, jotta niitä voidaan käyttää vastuullisesti.

Nykyään toinen eettinen taistelu valmistelee täysin itsenäisten tappajaherroneiden ja taistelukenttirobotien tuottamista edistyneiden AI-ihmisten tappajien avulla ilman, että ihmiset ovat silmukassa. Se panee puolustusministeriön ja DOD: n maksamien drooni- ja robottivalmistajien välillä ihmisten kanssa, joiden mielestä on järkevää ja moraalitonta luoda älykkäitä tappokoneita. Autonomisten droonien ja taistelukenttirobotien kannattajat väittävät olevansa moraalimpia - toisin sanoen vähemmän emotionaalisia, kohdistavat paremmin ja ovat kurinalaisempia kuin ihmisoperaattorit. Ne, jotka vastustavat ihmisten ottamista pois silmukasta, tarkastelevat droonien surkeata historiaa, jossa on tapettu siviilejä, ja osallistumista laittomiin murhiin. Kuka kantaa moraalisen syyllisyyden, kun robotti tappaa? Robotinvalmistajat, robotin käyttäjät vai ei kukaan? Älä koskaan tee teknisiä esteitä kertoa ystävälle vihollisesta.

Pidemmällä tähtäimellä, kuten kirjani asiantuntijat väittävät , ihmisten tason älykkyyttä lähestyvä AI ei ole helposti hallittavissa; valitettavasti superintelligenssi ei tarkoita hyväntahtoisuutta. Kuten AI-teoreetikko Eliezer Yudkowsky MIRI: stä (koneintelligen tutkimusinstituutti) toteaa, ”AI ei rakasta sinua eikä vihaa sinua, mutta sinut on tehty atomista, jota se voi käyttää jotain muuta.” Jos etiikka ei voi olla rakennettu koneeseen, niin me luomme erittäin älykkäitä psykopaatteja, olentoja, joilla ei ole moraalisia kompasseja, emmekä ole heidän mestarinsa pitkään.

Mitä uutta ajattelussa on?

Yhtä monimuotoiset yksilöt ja ryhmät kuin amerikkalainen tietotekniikan tutkija Bill Joy ja MIRI ovat jo kauan varoittaneet, että meillä on paljon pelättävää koneista, joiden älykkyys peittää omamme. Lopullisessa keksinnössämme väitän, että AI: tä käytetään myös väärin ihmisten tason älykkyyden kehityspolulla. Nykypäivän ja päivän välillä, jolloin tutkijat luovat ihmistason tiedustelua, meillä on AI: hen liittyviä virheitä ja rikollisia sovelluksia.

Miksi ei enempää ole tehty, tai mitä tehdään estääksemme AI: ta käynnistämästä meitä?

Ei ole yhtä syytä, mutta monia. Jotkut asiantuntijat eivät usko, että olemme riittävän lähellä inhimillisen tason tekoälyn luomiseen ja sen ulkopuolelle, että olemme huolissamme sen riskeistä. Monet AI-valmistajat voittavat sopimuksia Defense Advanced Research Projects Agencyn (DARPA) kanssa eivätkä halua nostaa esiin kysymyksiä, joita he pitävät poliittisina. Normaaliarviointi on kognitiivinen ennakkoluulo, joka estää ihmisiä reagoimasta katastrofeihin ja katastrofeihin tekemisen aikana - se on ehdottomasti osa sitä. Mutta monet AI-valmistajat tekevät jotain. Katso tutkijat, jotka neuvoo MIRI: tä. Ja paljon enemmän osallistuu, kun edistyneen AI: n vaarat siirtyvät valtavirtaista vuoropuhelua.

Voitko kuvailla hetken, jolloin tiesit, että tämä oli iso?

Me ihmiset ihmiset ohjaamme tulevaisuutta ei siksi, että olemme nopeimpia tai vahvimpia olentoja planeetalla, vaan koska olemme viisaimpia. Kun jaamme planeetan itseämme älykkäämpien olentojen kanssa, he ohjaavat tulevaisuutta. Kun ymmärsin tämän ajatuksen, tunsin kirjoittavani aikamme tärkeimmästä kysymyksestä.

Jokaisella suurella ajattelijalla on edeltäjiään, joiden työ oli hänen löytönsä kannalta ratkaiseva. Kuka antoi sinulle perustan ideasi rakentamiseen?

AI-riskianalyysin perustan ovat kehittäneet matemaatikko IJ Good, tieteiskirjailija Vernor Vinge ja muut, mukaan lukien AI-kehittäjä Steve Omohundro. Nykyään MIRI ja Oxfordin Humanity Institute -instituutti ovat melkein yksin käsitelleet tätä ongelmaa. Viimeisellä keksinnöllämme on noin 30 sivua päätemerkkejä, joissa tunnustetaan nämä ajattelijat.

Mikä on ollut korkein kohta tutkiessasi ja kehittäessäsi ideaasi? Ja matala kohta?

Korkeimpia kohtia olivat lopullisen keksintömme kirjoittaminen ja jatkuva vuoropuhelu AI-päättäjien ja teoreetikkojen kanssa. AI-ohjelmoijat ovat tietoisia turvallisuuskysymyksistä ja haluavat auttaa keksimään suojatoimenpiteitä. Esimerkiksi MIRI pyrkii luomaan ”ystävällisen” AI: n

Tietotekniikka ja teoreetikko Steve Omohundro on kannattanut ”telineiden” lähestymistapaa, jossa todistettavasti turvallinen AI auttaa rakentamaan seuraavan sukupolven AI varmistaakseen, että sekin on turvallista. Sitten, että AI tekee saman, ja niin edelleen. Mielestäni on luotava julkisen ja yksityisen sektorin kumppanuus, joka tuo AI-päättäjät yhteen jakamaan ideoita turvallisuudesta - jotain kuten Kansainvälinen atomienergiajärjestö, mutta yhteistyössä yritysten kanssa. Alhaiset kohdat? Huomaa, että aseiden luomiseen käytetään parasta, edistyneintä AI-tekniikkaa. Ja nämä aseet lopulta kääntyvät meitä vastaan.

Mitkä kaksi tai kolme ihmistä todennäköisimmin yrittävät kumota väitteesi? Miksi?

Keksijä Ray Kurzweil on edistyneiden tekniikoiden pääapuoliso. Kahdessa haastattelussa hänen kanssaan hän väitti, että sulaamme AI-tekniikoita kognitiivisten parannusten avulla. Kurzweil ja ihmiset, joita kutsutaan laajasti transhumanisteiksi ja singularitaareiksi, ajattelevat, että AI ja viime kädessä keinotekoinen älykkyys ja muutkin muuttuvat kanssamme. Esimerkiksi tietokoneimplantit parantavat aivojemme nopeutta ja yleisiä ominaisuuksia. Lopulta kehitämme tekniikkaa älykkyyden ja tietoisuutemme kuljettamiseen tietokoneisiin. Tällöin superintelligenssi on ainakin osittain ihminen, mikä teoriassa varmistaisi, että superintelligenssi oli "turvallinen".

Monista syistä en ole tämän näkökulman fani. Ongelmana on, että me ihmiset eivät ole luotettavasti turvallisia, ja on erittäin epätodennäköistä, että myös älykkäät ihmiset tulevat olemaan. Meillä ei ole aavistustakaan siitä, mitä tapahtuu ihmisen etiikalle sen jälkeen, kun hänen älykkyyttä on lisätty. Meillä on biologinen perusta aggressiivisuudelle, josta koneilla puuttuu. Superintelligenssi voi hyvinkin olla aggression kerroin.

Kenelle tämä idea vaikuttaa eniten?

Jokaisella planeetalla on paljon pelättävää älykkäiden koneiden sääntelemättömästä kehityksestä. Tiedustelukilpailu on parhaillaan käynnissä. AGI: n saavuttaminen on työpaikka ykköseksi Googlelle, IBM: lle ja monille pienille yrityksille, kuten Vicarious ja Deep Thought, sekä DARPA: lle, NSA: lle sekä ulkomaisille hallituksille ja yrityksille. Voitto on kilpailun päämotivaatio. Kuvittele yksi todennäköinen tavoite: virtuaali-ihmisen aivot tietokoneen hinnalla. Se olisi historian kannattavin hyödyke. Kuvittele pankkien tuhansien PhD-tason aivojen työskentelevän ympäri vuorokauden lääkkeiden kehittämisessä, syöpätutkimuksessa, aseiden kehittämisessä ja muussa. Kuka ei haluaisi ostaa kyseistä tekniikkaa?

Samaan aikaan 56 maata kehittää taistelukenttirobotteja, ja pyrkimyksenä on tehdä niistä ja droneista itsenäisiä. Ne ovat koneita, jotka tappavat, ilman ihmisen ohjausta. Köyhtyneet maat kärsivät eniten itsenäisistä drooneista ja taistelukenttiroboteista. Aluksi vain rikkaat maat voivat varata itsenäisiä tappamo-botteja, joten rikkaat maat käyttävät näitä aseita köyhdytettyjen maiden ihmissotilaita vastaan.

Kuinka se voi muuttaa elämää, koska tiedämme sen?

Kuvittele: niin vähän kuin kymmenessä vuodessa puoli tusinaa yritystä ja kansakuntaa kehittää tietokoneita, jotka kilpailevat tai ylittävät ihmisen älykkyyden. Kuvittele, mitä tapahtuu, kun näistä tietokoneista tulee asiantuntijoita älykkäiden tietokoneiden ohjelmoinnissa. Pian me jaamme planeetan koneiden kanssa tuhansia tai miljoonia kertoja älykkäämmiksi kuin me olemme. Ja koko ajan jokainen tämän tekniikan sukupolvi aseistetaan. Sääntelemätön, se on katastrofaalinen.

Mitä kysymyksiä jätetään vastamatta?

Ratkaisuja. Ilmeinen ratkaisu olisi antaa koneille moraalinen järkeä, joka saa ne arvostamaan ihmisen elämää ja omaisuutta. Mutta etiikan ohjelmointi koneeksi osoittautuu erittäin vaikeaksi. Moraaliset normit eroavat kulttuurista kulttuuriin, ne muuttuvat ajan myötä, ja ne ovat kontekstuaalisia. Jos me ihmiset emme pääse yksimielisyyteen elämän alkaessa, kuinka voimme kertoa koneelle elämän suojelemiseksi? Haluammeko todella olla turvallisia vai haluammeko todella olla ilmaisia ? Voimme keskustella siitä koko päivän eikä päästä yksimielisyyteen, joten miten voimme ohjelmoida sen?

Kuten aiemmin mainitsin, meidän on myös saatava AI-kehittäjät yhteen. 1970-luvulla yhdistelmä-DNA-tutkijat päättivät keskeyttää tutkimuksen ja kokoontua konferenssiin Asilomarissa Pacific Grovessa, Kaliforniassa. He kehittivät perusturvallisuusprotokollat, kuten "älä seuraa DNA: ta kengiltäsi" pelkääessäsi pilata ympäristöä käynnissä olevilla geneettisillä teoksilla. Asilomar-ohjeiden vuoksi maailma hyötyy muuntogeenisistä viljelykasveista, ja geeniterapia näyttää lupaavalta. Sikäli kuin tiedämme, onnettomuudet vältettiin. On aika Asilomar-konferenssille AI: lle

Mikä seisoo tiellä?

Valtava taloudellinen tuuli ajaa kehittyneen AI-ihmisen tason älykkyyden kehittämisen tietokoneen hintaan, mikä on historian kuumin hyödyke. Google ja IBM eivät halua jakaa salaisuuksiaan yleisölle tai kilpailijoille. Puolustusministeriö ei halua avata laboratorioita Kiinalle ja Israelille, ja päinvastoin. Yleisön tietoisuuden on lisättävä politiikkaa kohti avoimuutta ja julkisen ja yksityisen sektorin kumppanuuksia, joiden tarkoituksena on varmistaa turvallisuus.

Mikä on seuraava sinulle?

Olen dokumenttielokuvien ohjaaja, joten tietysti ajattelen meidän Final Invention -elokuvan elokuvaversiota.